Avec l'avènement de ChatGPT, Google y est allé de sa réponse avec Bard, une intelligence artificielle basée sur le modèle de langage expérimental LaMDA et ayant pour objectif d’intégrer le moteur de recherche de la société. Mais l’IA évolue si vite, que Mountain View commence à avoir des idées bizarres…

Google à contresens ?

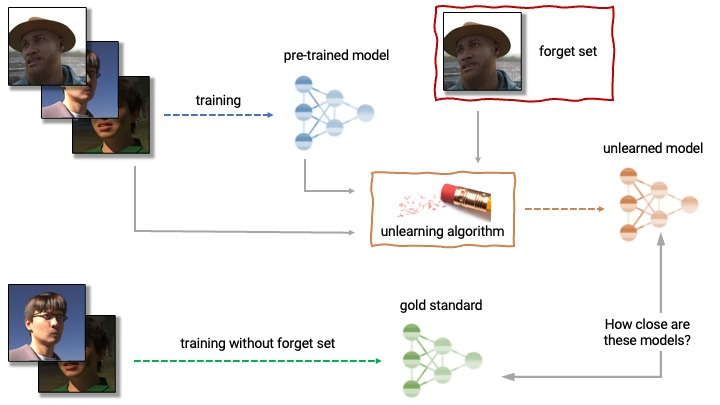

Dans le but de rappeler que tout ce qui touche à l'IA nécessite de la prudence, Google a annoncé un concours dans lequel les développeurs sont invités à faire tout le contraire de ce que l'on a vu ces derniers mois : faire désapprendre aux modèles d'IA ce qu'ils savent déjà. Autrement dit, faire du « machine unlearning » ! Et à vrai dire, il est pour le moins curieux qu'une des entreprises ayant un rôle central dans le développement de l'IA nous fasse la proposition suivante : développer des algorithmes d'entraînement capables d'éliminer l'influence des sous-ensembles à travers lesquels l’intelligence artificielle a appris.

Google explique que le « machine unlearning » est un terme émergeant dans le domaine de l'apprentissage automatique lui-même. Son but n'est pas de faire oublier à une IA tout ce qu'elle sait, mais plutôt de retirer l'influence de certains ensembles d'apprentissage. Selon Google, cela pourrait améliorer la confidentialité, atténuer les risques potentiels des modèles et alléger de gigantesques ensembles de données. Dans les faits, grâce au désapprentissage automatique (en français), il est possible de supprimer des informations inexactes ou obsolètes de modèles déjà entraînés, mais aussi d'éliminer des données manipulées ou encore de corriger des erreurs inhérentes à l'ensemble de données à partir duquel le modèle s'appuie.

L’idée de Google : désapprendre pour s'améliorer

Google souligne que mettre en place des stratégies de « machine unlearning » est particulièrement complexe, puisqu’il faut oublier certaines données du modèle sans détruire son utilité. De plus, en raison du manque de travaux sur le sujet, le défi d'évaluer l'efficacité de ces stratégies n’est clairement pas le plus simple. Et afin de promouvoir ce type de stratégie, l'entreprise annonce le premier Machine Unlearning Challenge, un événement qui fera partie des différentes compétitions du NeurIPS 2023. Ce défi est réalisé via Kaggle, une filiale de Google axée sur le machine learning et composée d'une large communauté. Le kit de démarrage est déjà disponible sur GitHub, et la concurrence a un curieux défi à relever.

Crédit photo : Google

En effet, ce défi part d'un scénario dans lequel un modèle capable de prédire l'âge via des images avec des données faciales a été formé. Après la formation, un certain sous-ensemble des images doit être oublié pour préserver la vie privée des personnes concernées. Et ce n'est pas si simple, puisqu’il y a des limites au temps d'exécution des algorithmes présentés. Le défi possède un intérêt particulier en tant que prélude de futurs modèles capables de corriger les apprentissages erronés ou incorrects dans les modèles d'IA. Si nous sommes déjà capables d’entrainer des machines et des programmes avec des ensembles de données gigantesques, il est maintenant temps d'apprendre à inverser ce processus.