ChatGPT et Bard ne sont pas incollables, et se trompent ou hallucinent très fréquemment. Mais Google pense avoir trouvé la solution pour que son modèle d’intelligence artificielle passe un nouveau cap !

Google a trouvé la solution pour que son chatbot raconte moins de bêtises

Avec l’essor récent des modèles d’intelligences artificielles - tels que ChatGPT et Bard - tout le monde a pu, plus ou moins, constater que les chatbots ne sont pas infaillibles et qu’il leur arrive parfois de raconter des bêtises. Cela se produit lorsque nous demandons des données que nous pouvons corroborer - historiques, par exemple - mais aussi lorsque nous leur demandons de programmer quelque chose ou de répondre à un problème mathématique. Mais visiblement, le chatbot de Google, Bard, vient de franchir une étape intéressante pour tenter de s'améliorer dans ce type de tâche.

Comme ils l'expliquent dans cette annonce Google, les grands modèles linguistiques (LLM) sont essentiellement des modèles prédictifs. Et même si cela est particulièrement efficace, dans les domaines créatifs et dans la génération de textes, le résultat est bien différent quand on veut des réponses précises dans des domaines comme les mathématiques ou la programmation. Et c’est précisément là que Bard pêchait… En effet, lorsqu’on lui posait des questions de mathématiques ou de programmations, le chatbot pouvait souvent donner la mauvaise réponse ou même indiquer immédiatement qu'il n'était pas prêt à répondre à de telles questions. Et c’est pourquoi, ils ont apporté une série de modifications qui permet désormais à Bard de mieux se comporter dans ces domaines.

Les pensées d’un prix Nobel ont mis Google sur la bonne voie

La méthode trouvée par Google s’inspire d’une dichotomie bien étudiée de l’intelligence humaine, notamment abordée dans le livre de Daniel Kanheman - prix Nobel d’économie - Think Fast, think slow, où il parle du « Système 1 » et du « Système 2 » de la pensée. Le premier est plus intuitif et donne des réponses rapides, tandis que le second est plus lent et réfléchi. Ainsi, si nous partons de ce postulat, nous pourrions dire que les LLM font plutôt partie du système 1. Cependant, l'informatique traditionnelle est alignée sur le système 2. La méthode que Bard utilise pour « penser lentement » est dans l'exécution de code explicite : lorsqu'il identifie des commandes (prompt) qui peuvent bénéficier d'un code logique, il utilise ce code en arrière-plan pour produire des résultats plus précis.

Crédit photo : Google

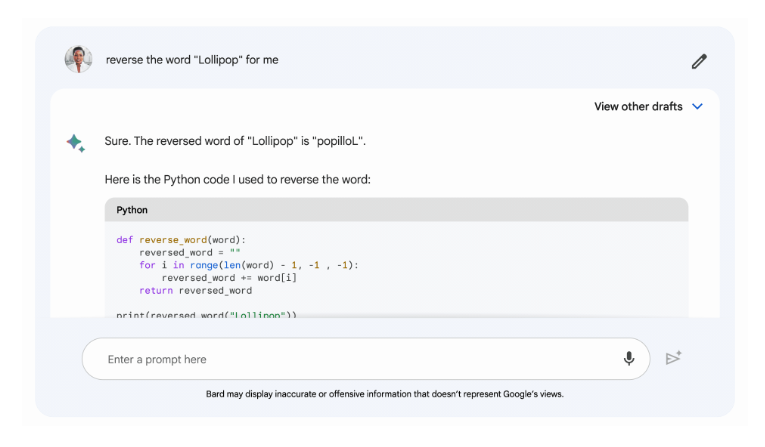

Pour vérifier ce changement, il suffit d’inverser les lettres d’un mot. Même si cela peut paraître simple, Bard n’en était pas capable il y a quelques semaines, alors qu’il est aujourd’hui en capacité de redonner son vrai visage à un mot écrit à l’envers. Ces modifications lui permettent aussi de mieux répondre aux problèmes mathématiques et de mieux s’adapter aux langages de programmation. Néanmoins, et selon les tests de Google, cette méthode permet d’améliorer les réponses d'environ 30%. Ils précisent d’ailleurs également que ce n'est encore toujours parfait - notamment pour ce qui concerne les problèmes mathématiques.